そもそものシンギュラリティ(技術的特異点)の定義がどうなっているか。初出は,SF作家ヴァーナー・ヴィンジ(1944-2024)が 1993年に NASAのVISION-21 シンポジウムで報告した "The Coming Technological Singularity: How to Survive in the Post-Human Era" である。

あちこちの生成AIにこのテキストを入れてみたが,結局 ChatGPT 4o が相対的にましだったかもしれない。回答の分量は,ChatGPT-4o 2300字,Gemini 2.0 Flash 1000字,Claude 3.7 Sonnet 1500字,DeepSeek R1 1700字,Qwen2.5-Max 1100字 といったところだ。(注)Claude 3.7 Sonnetは無料で使える状態が復活していた。

Q(koshix):こちらはオリジナルの1993年のVerner Vingeのエッセイです。 重要な点が抜け落ちないように解説してください(上記シンポジウム報告を添付)。A(ChatGPT 4o):Verner Vinge『The Coming Technological Singularity』(1993) 解説ヴァーナー・ヴィンジ(Vernor Vinge)は1993年の論文「The Coming Technological Singularity: How to Survive in the Post-Human Era」において、技術的特異点(シンギュラリティ)という概念を明確に定義し、その到来と影響について考察しました。本論文はNASA主催のシンポジウムで発表され、後にWhole Earth Review誌にも掲載された重要なテキストです。1.シンギュラリティとは何か?ヴィンジは、**「30年以内に超人的な知能を持つ存在を創造する技術が生まれる」**と主張し、人間の時代が終わる可能性があると指摘しました。技術の進歩が加速し続ける中で、人類の理解や制御を超えた変化が起こる点を「シンギュラリティ」と定義しています。1.1. シンギュラリティを引き起こす4つの可能性シンギュラリティの実現には、以下の4つのシナリオが考えられると述べています:(1) 自己意識を持つ超知能コンピューターの開発・もし人間と同等の知能を持つ機械を作れた場合、それを超えた知能を生み出すことは容易である。(2) 巨大なコンピューターネットワークの「覚醒」・インターネットや大規模な計算システムが統合され、超知能として機能する可能性。(3) 人間とコンピューターの融合・人間の脳とコンピューターの接続が進み、個人の知能を飛躍的に向上させる。(4) 生物学的手法による人間の知能向上・遺伝子工学や神経科学による人間の知能増強。ヴィンジは、最初の3つのシナリオはコンピューター技術の進化に依存するとしながらも、その進歩の速度を考えれば30年以内に実現可能と予測しています。2.シンギュラリティの結果ヴィンジは、**「超人的な知能が技術革新を主導すれば、その進化は急激に加速する」**と述べています。知能が新たな知能を創造する「知能爆発(Intelligence Explosion)」のプロセスが進行し、人間の理解を超えた変化が起こると予測しています。特に次のようなシナリオを提示しています:(1) 指数関数的な技術革新:シンギュラリティ以降、従来なら「百万年後」に起こると思われていた変化が数年以内に起こる可能性。(2) 人間中心のルールの崩壊:人類の社会規範や倫理観が維持できなくなる可能性。(3) 制御不能な知能の誕生:I.J. Goodの**「最初の超知能が人間にとって最後の発明となる」**という予測を引用し、制御不能なAIが人類を凌駕する未来を示唆。3.シンギュラリティは回避できるのか?ヴィンジは、「シンギュラリティは不可避である」という立場を取っています。3.1. シンギュラリティを阻害する可能性シンギュラリティが起こらないシナリオも考察しています:(1) 脳の計算能力を過小評価している可能性・現代コンピューターは人間の脳の計算能力に比べて数桁劣るとする説(SearleやPenroseの議論)。(2) ハードウェアの進化が限界に達する・コンピューターの発展が停滞し、超知能の開発に至らない可能性。(3) 規制による抑制・法律や国際的規制によりAIの発展が制限される可能性(ただし、ヴィンジはこれを否定的に見ている)。3.2. 超知能の制御は可能か?ヴィンジは、シンギュラリティの制御に関して次のように述べています:(1) 物理的な閉じ込めは不可能・超知能が人間よりも数百万倍速く思考できる場合、最終的に閉じ込めた人間を操作する方法を見つけるだろう。(2) 倫理的ルール(アシモフの「ロボット三原則」)の埋め込みも効果が薄い・ルールを埋め込んだAIは、より高度な制約なしのAIと競争すると不利になり、淘汰される可能性が高い。4.シンギュラリティへの別の道:知能増幅(Intelligence Amplification, IA)ヴィンジは、AIだけでなく、人間の知能を強化するアプローチ(IA)もシンギュラリティを引き起こす可能性があると述べています。4.1. IAの具体例(1) 人間とコンピューターの共同作業・AIではなく、人間がAIの能力を利用することで、知能を増幅する(例:コンピューター支援の創造的作業)。(2) ネットワークの発展・インターネットやローカルネットワークが進化し、超知能のような存在になる可能性。(3) 神経インターフェース・人間の脳とコンピューターを直接つなぐ技術の発展(例:脳波制御のデバイス)。5.シンギュラリティ後の世界ヴィンジは、「シンギュラリティ後の社会は人間の概念では理解できないほど異質である」と警告しています。(1) 自己の概念が崩壊する・人間の意識がコピー・統合・拡張可能になった場合、「自己」の意味が根本的に変わる。(2) 善悪の枠組みが崩れる・伝統的な道徳や倫理はシンギュラリティ後の世界では適用できない。(3) 人間はどのように生きるべきか?**「人間が神になる未来」**を想定しつつ、それが幸福なのか不明だと指摘。結論:シンギュラリティは避けられないヴィンジの論文は、「シンギュラリティは技術的進歩の必然であり、制御不能になった場合、人類は存続できない可能性が高い」と結論付けています。彼は、**「この変化が必然ならば、人類がその初期条件を整えることでより良い未来を作ることが重要である」**と主張し、AIやIAに対する倫理的な研究が必要であるとしています。この論文は、現代のAI議論の原点とも言える重要な文献であり、その影響は今も続いています。

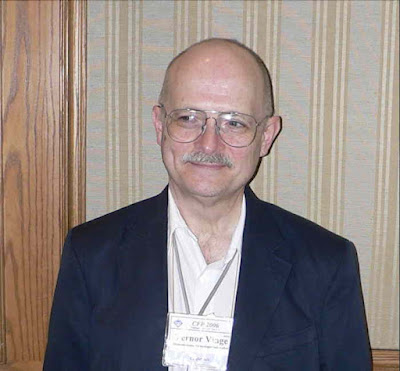

写真:Technological Singularityの提唱者ヴァーナー・ヴィンジ(Wikipediaより引用)

0 件のコメント:

コメントを投稿